Serwery stanowią podstawę nowoczesnej infrastruktury IT, zasilając wszystko, od małych witryn biznesowych po ogromne platformy przetwarzania w chmurze. Podczas gdy termin "serwer" często kojarzy się z pojedynczą fizyczną skrzynką umieszczoną w szafie centrum danych, w rzeczywistości obejmuje on szeroką gamę sprzętu zaprojektowanego w celu spełnienia różnych wymagań dotyczących wydajności, przestrzeni i energii. Poniżej przedstawiamy najpopularniejsze typy sprzętu serwerowego, w tym zarówno kompletne systemy serwerowe, jak i kluczowe komponenty pomocnicze.

1. Fizyczne formaty serwerów

Opis: Zaprojektowane do montażu w znormalizowanych 19-calowych szafach rack (lub, rzadziej, 23-calowych szafach rack), serwery rack są zoptymalizowane pod kątem środowisk o dużej gęstości. Każdy serwer ma zazwyczaj wysokość od 1U do 4U (gdzie "U" równa się 1,75 cala).

Kluczowe cechy:

- Oszczędność miejsca: Wiele jednostek rack można układać pionowo, co czyni je idealnym rozwiązaniem dla centrów danych o ograniczonej powierzchni.

- Łatwość serwisowania: Dostępne od przodu dyski, zasilacze i gniazda rozszerzeń ułatwiają konserwację i wymianę podczas pracy.

- Skalowalność: W miarę wzrostu zapotrzebowania można łatwo dodawać kolejne serwery stelażowe.

Przypadki użycia: Centra danych przedsiębiorstw, obiekty hostingowe w chmurze, klastry wirtualizacji.

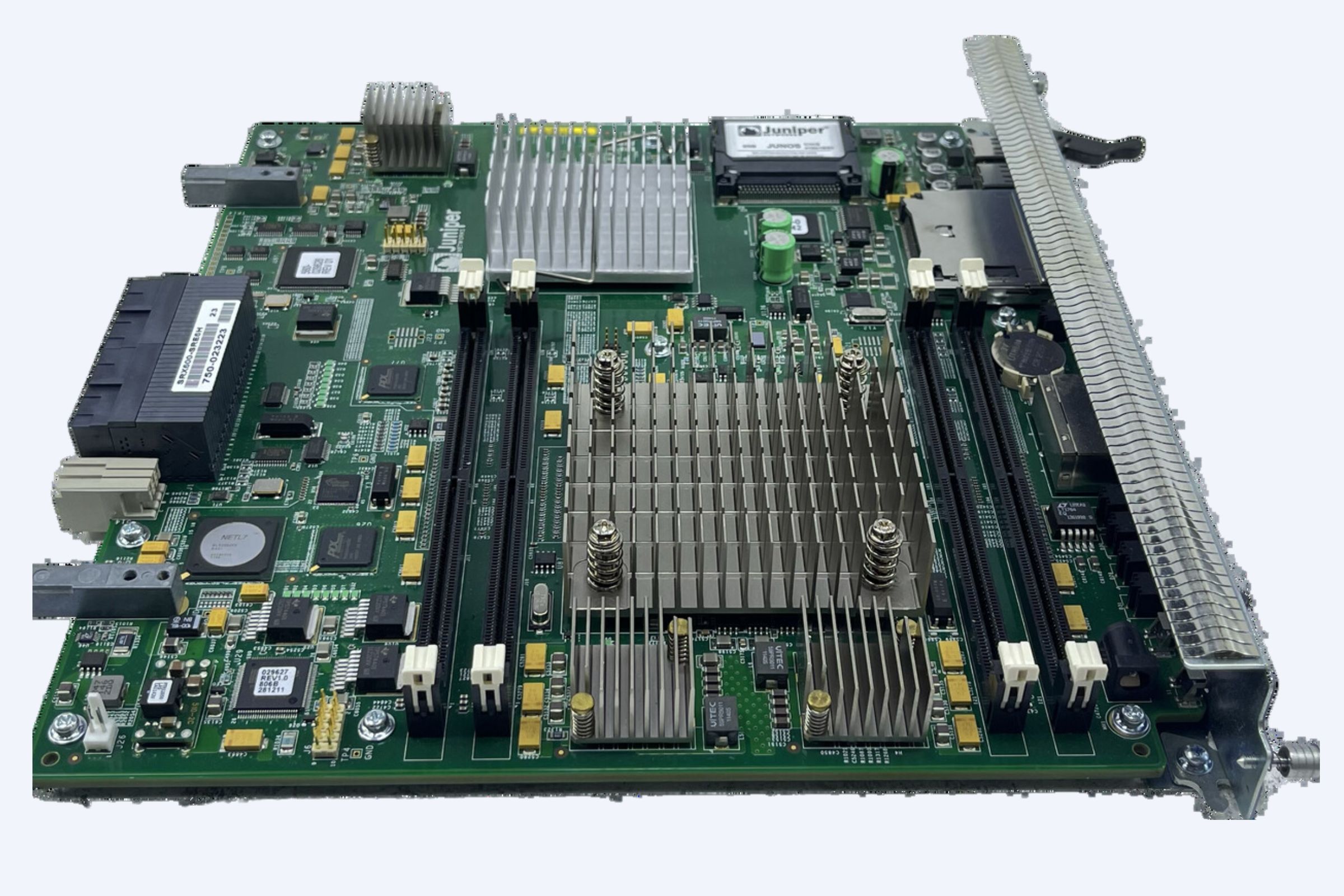

Serwery blade

Opis: Serwery blade to ultracienkie, modułowe jednostki, które wsuwa się do wspólnej obudowy. Obudowa zapewnia zasilanie, chłodzenie, łączność sieciową i zarządzanie, umożliwiając każdemu serwerowi typu blade pominięcie wielu z tych komponentów w celu uzyskania większej gęstości.

Kluczowe cechy:

- Wysoka gęstość: Dziesiątki serwerów blade mogą współdzielić pojedynczą obudowę zajmującą zaledwie kilka jednostek stelażowych.

- Scentralizowane zarządzanie: Często są wyposażone w zintegrowane moduły zarządzania zasilaniem, chłodzeniem i przełącznikami sieciowymi.

- Ograniczone okablowanie: Współdzielona infrastruktura w obudowie minimalizuje ilość kabli zewnętrznych.

Przypadki użycia: Środowiska wymagające ogromnej gęstości obliczeniowej - takie jak wysokowydajne klastry obliczeniowe (HPC), duże farmy wirtualizacji lub zaplecze telekomunikacyjne.

Serwery wieżowe

Opis: Przypominające tradycyjne wieże komputerów stacjonarnych, te samodzielne serwery są przeznaczone do biur lub oddziałów, w których przestrzeń w szafie jest niedostępna.

Kluczowe cechy:

- Możliwość rozbudowy: Zazwyczaj oferują więcej wewnętrznych kieszeni na dyski i gniazd rozszerzeń PCIe w porównaniu do serwerów stelażowych w podobnej cenie.

- Mniejsze zapotrzebowanie na infrastrukturę: Może pracować na standardowych biurkach bez specjalistycznych szaf czy chłodzenia.

- Hałas i rozmiar: Zwykle są większe i głośniejsze niż opcje rack lub blade, co czyni je mniej odpowiednimi do środowisk wrażliwych na hałas.

Przypadki użycia: Małe i średnie firmy, zdalne biura lub domowe laboratoria, w których wystarczy jeden lub dwa serwery.

Mikroserwery

Opis: Ultrakompaktowe serwery, które często przedkładają niskie zużycie energii nad surową moc obliczeniową. Mogą przypominać małe komputery stacjonarne lub nawet mniejsze "pudełka na pizzę".

Kluczowe cechy:

- Efektywność energetyczna: Niskowatowe procesory i minimalne komponenty zmniejszają pobór mocy.

- Ograniczone możliwości rozbudowy: Zazwyczaj tylko jedna lub dwie kieszenie na dyski i minimalna liczba gniazd PCIe.

- Gęstość: Mogą być gęsto upakowane - niektóre modele pozwalają na umieszczenie dziesiątek mikroserwerów w jednej szafie.

Przypadki użycia: Lekkie serwery internetowe, przetwarzanie brzegowe, sieci dostarczania treści (CDN) lub skalowalne architektury mikrousług.

2. Podstawowe komponenty wewnętrzne

Poza ogólnymi czynnikami kształtu, niektóre wewnętrzne elementy sprzętowe definiują wydajność, niezawodność i przydatność serwera do różnych zadań. Komponenty te często określają klasyfikację i zastosowanie serwera.

Rodzaje:

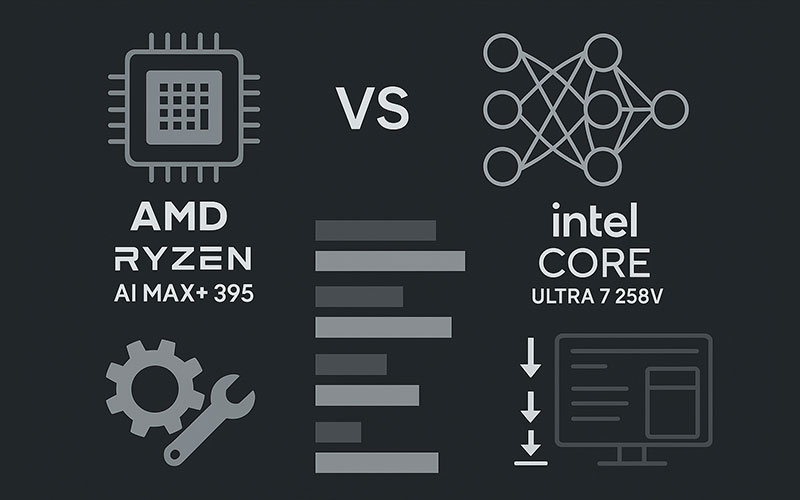

- Wielordzeniowy Xeon/EPYC: Intel Xeon i AMD EPYC to dwie wiodące linie procesorów klasy serwerowej, oferujące dziesiątki rdzeni na gniazdo, 64+ linii PCIe i duże pamięci podręczne.

- Procesory oparte na architekturze ARM: Pojawiające się w środowiskach hiperskalowych układy ARM zapewniają wysoką wydajność energetyczną dla zadań skalowalnych.

Cechy do rozważenia:

- Liczba rdzeni i taktowanie: Równoważenie wydajności jednowątkowej i wielowątkowej.

- Projektowa moc cieplna (TDP): Wpływa na wymagania dotyczące chłodzenia i zużycie energii.

- Zintegrowane funkcje: Akceleratory szyfrowania, liczba kanałów pamięci i rozszerzenia wirtualizacji.

Pamięć (RAM)

Rodzaje:

- Zarejestrowane moduły DIMM ECC (RDIMM): Pamięć z kodem korekcji błędów jest prawie powszechna w ustawieniach serwerów, aby zapobiec uszkodzeniu danych.

- Moduły DIMM o zmniejszonym obciążeniu (LRDIMM): Oferują większą pojemność na moduł, przydatną w przypadku obciążeń intensywnie wykorzystujących pamięć (bazy danych, analizy w pamięci).

Kluczowe wskaźniki:

- Pojemność: Serwery mogą obsługiwać od kilku gigabajtów do wielu terabajtów, w zależności od liczby gniazd DIMM i rozmiarów modułów.

- Prędkość: Od DDR4-2133 MT/s do DDR5-6400 MT/s, co wpływa na przepustowość danych.

- Konfiguracja kanałów: Dwukanałowe, czterokanałowe lub ośmiokanałowe kontrolery pamięci zwiększają przepustowość.

Podsystemy pamięci masowej

Dyski twarde (HDD):

- Opis: Tradycyjne dyski talerzowe oferujące dużą pojemność przy niższym koszcie w przeliczeniu na gigabajt.

- Przypadki użycia: Masowe przechowywanie na zimno, repozytoria kopii zapasowych lub tam, gdzie dominuje przepustowość, a nie opóźnienia.

Dyski półprzewodnikowe (SSD):

- Dyski SSD SATA/SAS: Podłączane do standardowych wnęk na dyski, zazwyczaj ograniczone do około 6 Gb/s (SATA) lub 12 Gb/s (SAS).

- Dyski SSD NVMe (PCIe): Pomijają starsze kontrolery pamięci masowej, zapewniając znacznie niższe opóźnienia i wyższy IOPS. Dostępne w formacie U.2, M.2 lub karty rozszerzeń.

- Dyski SSD klasy korporacyjnej i konsumenckiej: dyski SSD klasy korporacyjnej zapewniają wyższą trwałość zapisu i ochronę przed utratą zasilania.

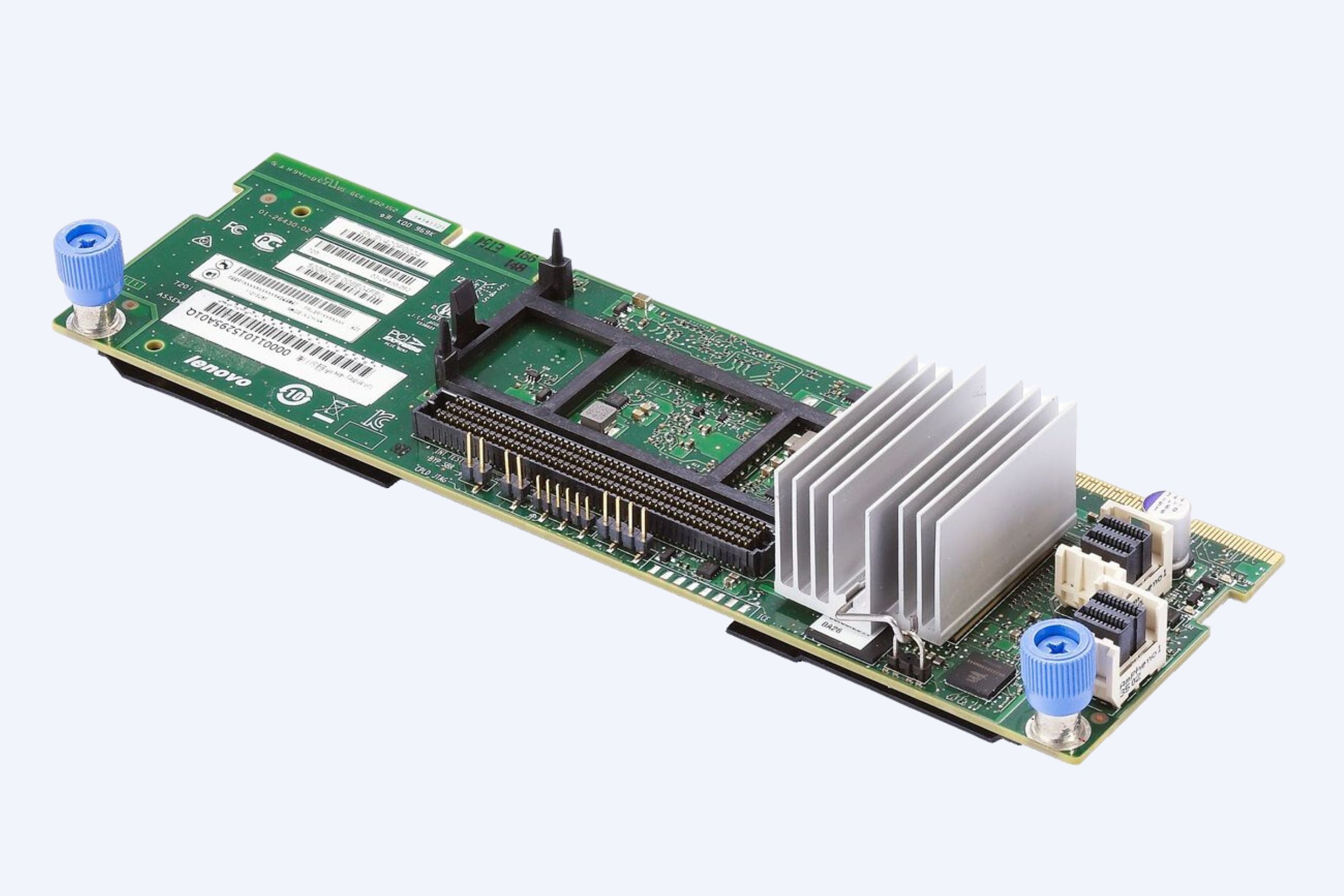

Kontrolery pamięci masowej i karty RAID:

- Sprzętowe kontrolery RAID: Odciążenie zadań parzystości i tworzenia kopii lustrzanych, oferując moduły pamięci podręcznej zasilane bateryjnie lub oparte na pamięci flash.

- Opcje pamięci masowej definiowanej programowo (SDS): Wykorzystanie cykli procesora i warstw oprogramowania (np. Ceph, ZFS) do łączenia dysków.

Sieciowa pamięć masowa (NAS) i sieci pamięci masowej (SAN):

- NAS: Pamięć masowa na poziomie plików dostępna przez standardową sieć Ethernet (np. NFS, SMB). Często wdrażane za pomocą dedykowanych urządzeń lub serwerów NAS.

- SAN: Pamięć masowa na poziomie bloków przez Fibre Channel lub iSCSI, zwykle przy użyciu dedykowanych kart HBA i przełączników Fibre Channel.

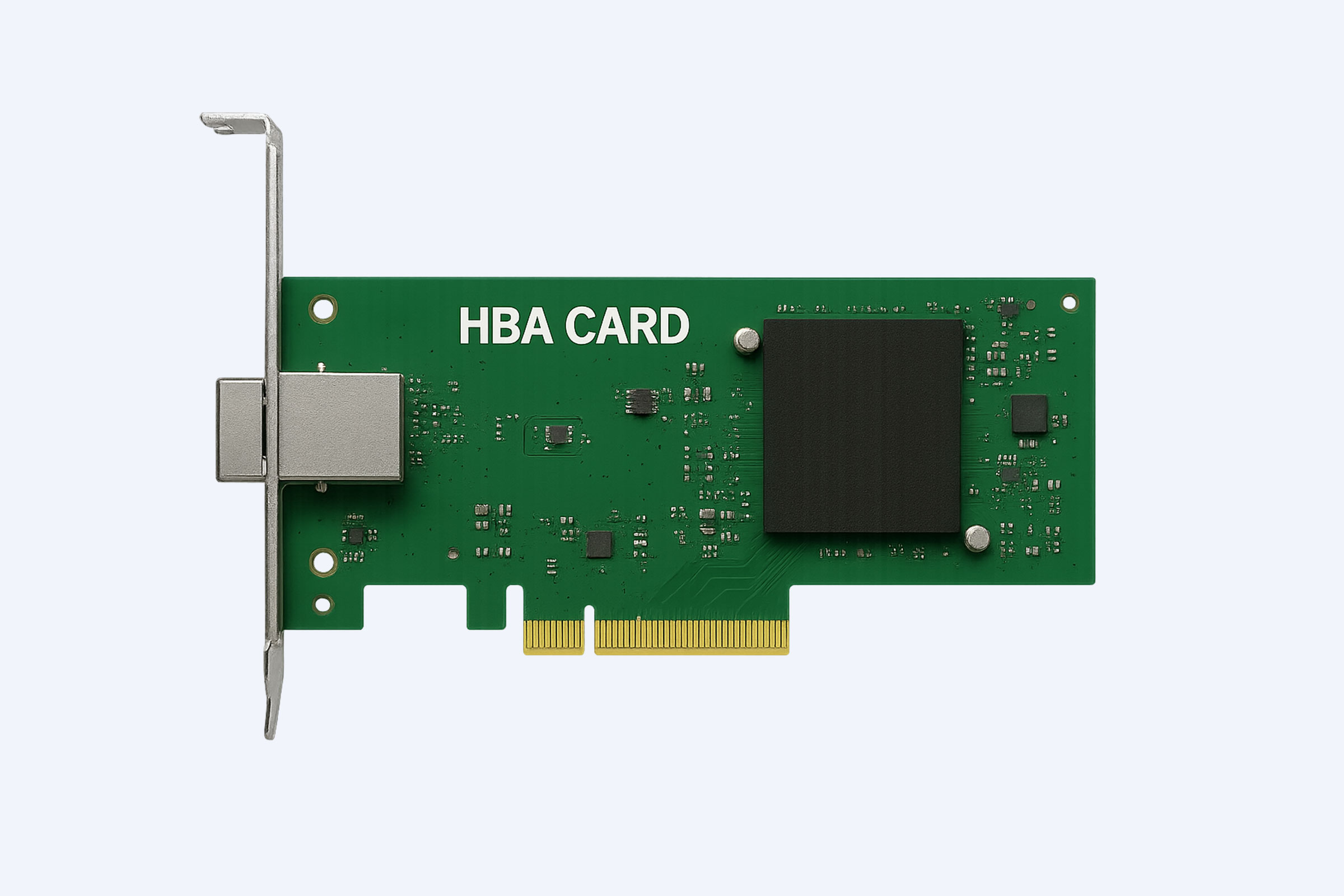

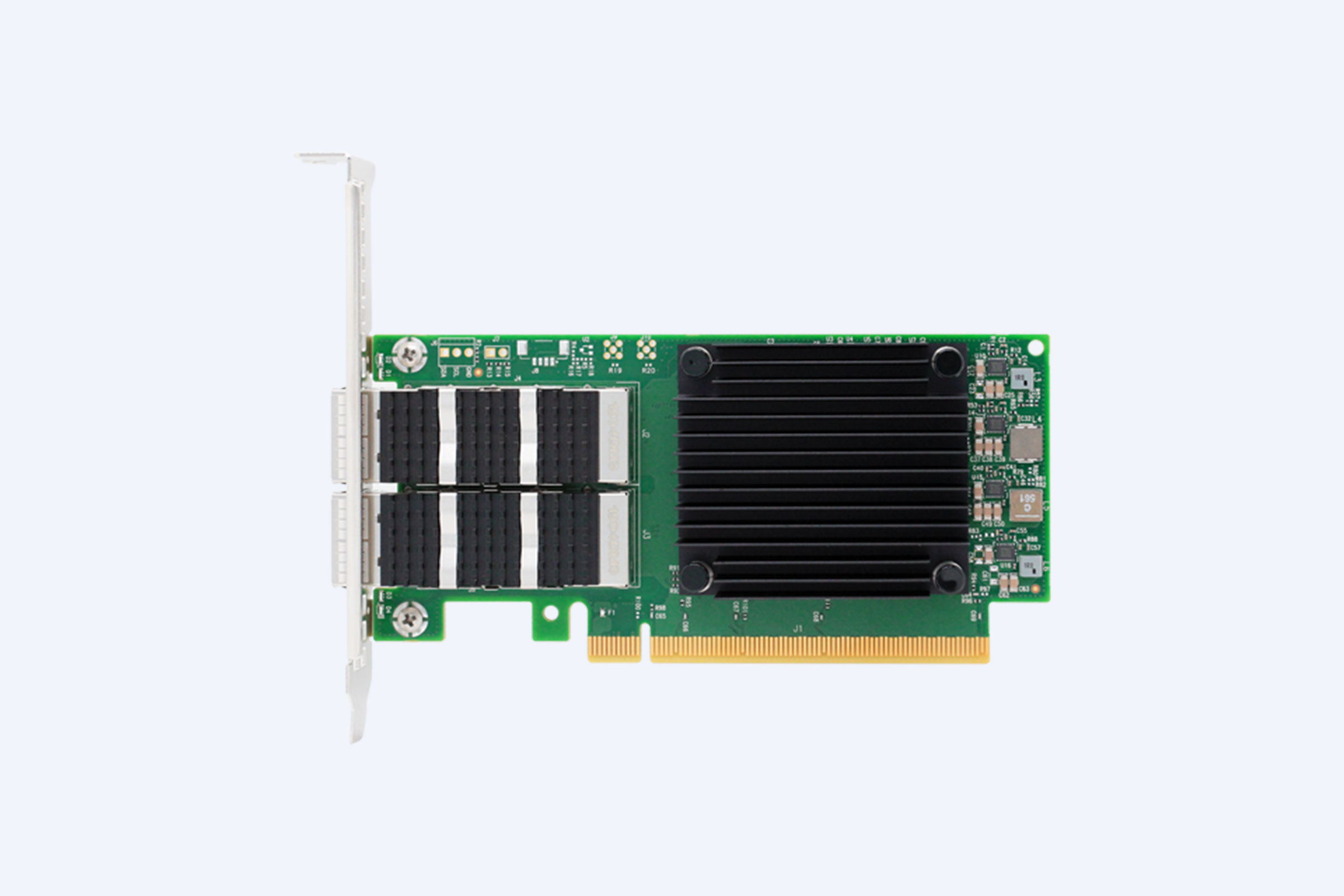

Karty interfejsów sieciowych (NIC)

- Standardowe karty sieciowe Ethernet: Dostępne w prędkościach 1GbE, 10GbE, 25GbE, 40GbE i 100GbE; ważne przy określaniu przepustowości sieci i komunikacji między serwerami.

- SmartNIC (jednostki przetwarzania danych): Odciążenie zadań sieciowych, bezpieczeństwa lub pamięci masowej - idealne dla hiperskalowych centrów danych lub hostów wirtualizacji.

- Adaptery magistrali hosta Fibre Channel (HBA): Niezbędne do bezpośrednich połączeń z sieciami SAN Fibre Channel.

Zasilacze i nadmiarowość

- Zasilacze z możliwością wymiany podczas pracy: Często serwery są wyposażone w dwa (lub więcej) nadmiarowe zasilacze; jeśli jeden ulegnie awarii, drugi płynnie przejmie obciążenie.

- Poziomy certyfikacji 80 PLUS: Od brązowego do tytanowego, co oznacza wydajność w typowych warunkach obciążenia. Wyższa wydajność zmniejsza koszty energii i zapotrzebowanie na chłodzenie.

- Jednostki dystrybucji zasilania (PDU): Jednostki montowane w szafach rack, które dystrybuują zasilanie AC do wielu serwerów, często z możliwością zdalnego monitorowania.

Rozwiązania chłodzące

- Chłodzenie powietrzem: Wysokowydajne wentylatory (przepływ powietrza od przodu do tyłu) w połączeniu z radiatorami na procesorach i innych gorących komponentach.

- Chłodzenie cieczą: W środowiskach, w których chłodzenie powietrzem jest niewystarczające (np. serwery GPU o dużej gęstości), niektóre centra danych wdrażają chłodzone cieczą obudowy serwerów lub tylne wymienniki ciepła.

- Wentylatory i kanały wentylacyjne w obudowie: Wiele serwerów posiada wiele wewnętrznych wentylatorów, aby utrzymać optymalny przepływ powietrza między komponentami. Kanały kierują chłodne powietrze od przodu do tyłu, redukując gorące punkty.

3. Specjalistyczne klasy serwerów

Serwery z akceleracją GPU

Opis: Wyposażony w jeden lub więcej wysokowydajnych procesorów graficznych (np. NVIDIA A100, AMD Instinct) obok procesorów centralnych.

Charakterystyka:

- Wysokie zapotrzebowanie na moc i chłodzenie: Każdy procesor graficzny może zużywać setki watów, co wymaga solidnej infrastruktury chłodzenia.

- Alokacja pasów PCIe: Wymaga płyt głównych zaprojektowanych do obsługi wielu gniazd x16 przy pełnej przepustowości.

Przypadki użycia: Trening uczenia maszynowego, obciążenia związane z wnioskowaniem, symulacje naukowe, transkodowanie wideo.

Serwery o wysokiej gęstości/hiperkonwergentne

Opis: Połączenie obliczeń, pamięci masowej i sieci w jednym urządzeniu lub węźle, często jako część infrastruktury hiperkonwergentnej (HCI).

Charakterystyka:

- Zintegrowany stos oprogramowania: Wiąże wirtualizację (np. VMware vSAN, Nutanix Acropolis) w celu łączenia zasobów w wielu węzłach.

- Skalowalność przez dodawanie węzłów: Skaluj zarówno pamięć masową, jak i obliczenia, po prostu dodając więcej identycznych węzłów.

Przypadki użycia: Infrastruktura wirtualnych desktopów (VDI), konsolidacja oddziałów, wdrożenia w chmurze prywatnej.

Serwery Edge/IoT

Opis: Kompaktowe, wzmocnione serwery zbudowane do pracy w nietradycyjnych środowiskach - halach produkcyjnych, punktach sprzedaży detalicznej, telekomunikacyjnych stacjach bazowych.

Charakterystyka:

- Tolerancja środowiskowa: Rozszerzone specyfikacje temperatury, wilgotności i wstrząsów/wibracji.

- Modułowe wejścia/wyjścia: Obsługa protokołów przemysłowych (np. Modbus, magistrala CAN) obok standardowego Ethernetu.

Przypadki użycia: Przemysłowe systemy sterowania, lokalna agregacja danych, przetwarzanie bramek IoT.

4. Sprzęt pomocniczy i wspierający

Funkcja: Zapewnia tymczasowe, czyste zasilanie podczas przerwy w dostawie energii elektrycznej, zapobiegając nagłym wyłączeniom i umożliwiając płynne wyłączanie serwerów lub przełączanie na generatory zapasowe.

Rodzaje:

- UPS w trybie gotowości (offline): Utrzymuje zasilanie krytycznych komponentów, przełącza się na baterię w przypadku awarii sieci (krótki czas transferu).

- UPS Line-Interactive: Ciągle reguluje napięcie; lepszy dla obszarów o zmiennej jakości zasilania.

- Zasilacz UPS z podwójną konwersją online: Zapewnia najczystsze zasilanie z zerowym czasem transferu; idealny dla bardzo wrażliwych lub krytycznych serwerów.

Przełączniki KVM (klawiatura, wideo, mysz)

Cel: Umożliwienie administratorom kontrolowania wielu serwerów z jednej konsoli, zmniejszając potrzebę stosowania oddzielnych monitorów i klawiatur dla każdego serwera.

Cechy:

- Cyfrowy KVM przez IP: Umożliwia zdalne zarządzanie przez sieć LAN lub WAN.

- Lokalne szuflady KVM: Wsuwane do szaf i zapewniające zintegrowaną klawiaturę, monitor i touchpad do administracji na miejscu.

Moduły zarządzania i karty zdalnego zarządzania

Kontroler zarządzania płytą główną (BMC): Wbudowany mikrokontroler zapewniający dostęp poza pasmem (IPMI, Redfish) w celu monitorowania stanu sprzętu, włączania/wyłączania serwerów i montowania nośników wirtualnych.

Rozwiązania własne:

- iDRAC (Dell), iLO (HP), IMM (Lenovo): Ulepszone funkcje zarządzania, aktualizacje oprogramowania sprzętowego i pulpity monitorowania sprzętu.

Przełączniki sieciowe i sprzęt agregujący

- Przełączniki Top-of-Rack (ToR): Agregują połączenia z serwerów stelażowych; często zapewniają porty 10GbE połączone z przełącznikami agregującymi/rdzeniowymi.

- Architektury Leaf-Spine: W nowoczesnych centrach danych przełączniki typu leaf łączą się bezpośrednio z kartami NIC serwerów, podczas gdy przełączniki typu spine zapewniają łączność szkieletową o wysokiej przepustowości.

Okablowanie i zarządzanie kablami

- Okablowanie strukturalne: Obejmuje CAT6/6A do 10GbE lub wyższych; światłowody (OM4, OS2) do 40GbE, 100GbE lub długich przebiegów.

- Korytka kablowe, ramiona zarządzające, paski na rzepy: Utrzymują przepływ powietrza i upraszczają prowadzenie kabli podczas konserwacji.

5. Pojawiające się trendy i rozważania

Modułowe centra danych

Wstępnie zmontowane, kontenerowe szafy zawierające serwery, chłodzenie i dystrybucję zasilania. Można je szybko wdrożyć na brzegu sieci lub jako tymczasową pojemność.

Przyjęcie serwerów opartych na architekturze ARM

Firmy takie jak Amazon (instancje Graviton), Ampere i Marvell wprowadzają ARM do głównego nurtu obciążeń serwerowych, obiecując lepszą wydajność w przeliczeniu na wat dla niektórych aplikacji natywnych dla chmury.

Infrastruktura kompozytowa

Korzystanie z "zdezagregowanych" pul procesora, pamięci, pamięci masowej i akceleratorów, które można udostępniać i rekonfigurować za pomocą oprogramowania, bez fizycznego przenoszenia sprzętu. Wymaga wyspecjalizowanych sieci połączeń (np. NVMe over Fabrics).

Współprocesory AI i układy FPGA

Oprócz układów GPU, tablice bramek programowalnych (FPGA) i dedykowane akceleratory AI (takie jak TPU firmy Google) integrują się z ofertą serwerów w celu przyspieszenia zadań wnioskowania przy niższych opóźnieniach i poborze mocy.

Ekologiczny/zrównoważony sprzęt

Większy nacisk na kompatybilność z energią odnawialną, materiały pochodzące z recyklingu i wyższe oceny efektywności energetycznej. Niektórzy dostawcy publikują obecnie szacunki "śladu węglowego" dla poszczególnych serwerów.

Wnioski

Sprzęt serwerowy obejmuje zróżnicowany ekosystem czynników kształtu, komponentów wewnętrznych, wyspecjalizowanych akceleratorów i sprzętu pomocniczego. Niezależnie od tego, czy potrzebujesz zajmującego niewiele miejsca serwera kasetowego do środowiska klastrowania o dużej gęstości, wytrzymałego mikroserwera na brzegu sieci, czy też potężnej platformy z procesorem graficznym do uczenia maszynowego, istnieje sprzęt dostosowany do praktycznie każdego wymagania. Kluczowe kwestie - takie jak gęstość obliczeniowa, wydajność energetyczna, możliwość rozbudowy i łatwość zarządzania - kierują wyborem sprzętu serwerowego i powiązanych komponentów. Wraz z ewolucją technologii (np. przyjęciem ARM, infrastrukturą komponowalną, koprocesorami AI), oferta serwerów będzie się nadal różnicować, umożliwiając organizacjom precyzyjne dostosowanie inwestycji w sprzęt do wymagań obciążenia i celów zrównoważonego rozwoju.